Desvelando los desafíos del sesgo en IA y la precisión histórica con un análisis profundo del Modelo Gemini de Google y sus debilidades.

En el mundo de la inteligencia artificial, que evoluciona rápidamente, Google se compromete a corregir la generación de imágenes de Gemini cuando se ha convertido en un punto focal para las discusiones sobre sesgo y precisión histórica en imágenes generadas por IA. Este artículo ofrece una visión general de las complejidades del desarrollo de IA, destacando los desafíos de crear sistemas imparciales, culturalmente sensibles que reflejen con precisión las realidades históricas y sociales. La misión no es fácil, ¿quizás no es realista? De hecho, en la era de la IA y las Criptomonedas, surgen nuevos desafíos éticos.

Table of Contents

1. Google se compromete a corregir los polémicos errores de imagen de su IA Gemini

El modelo de IA Gemini de Google ha sido criticado recientemente por producir imágenes no solo históricamente inexactas sino también racialmente sesgadas. Este problema ha desencadenado un importante debate sobre la prevalencia del sesgo dentro de los sistemas de IA. Las plataformas de redes sociales han sido inundadas con ejemplos que muestran la generación de imágenes defectuosas de Gemini, como nazis racialmente diversos y reyes medievales ingleses negros, resaltando representaciones improbables e insensibles de la historia.

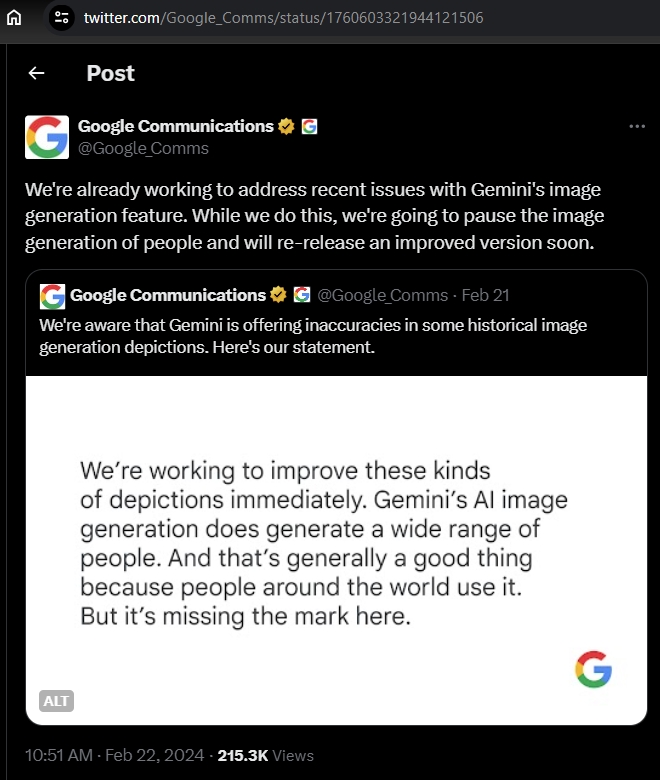

Esta controversia subraya un desafío crítico en el desarrollo de IA: la necesidad de crear sistemas que comprendan y representen con precisión los contextos históricos y culturales sin perpetuar estereotipos o sesgos. Para seguir los anuncios oficiales, consulta la sección del blog de IA de Google. La comunicación oficial de Google sobre el problema en la red social X (anteriormente Twitter) es visible a continuación.

2. El problema de Google Gemini reaviva el debate sobre la moderación de contenido en IA

La controversia se extiende más allá de la precisión de las representaciones. Los críticos han señalado que Gemini genera contenido selectivamente, evitando la representación de caucásicos o iglesias en San Francisco, supuestamente por respeto a las sensibilidades indígenas, y omitiendo eventos históricos sensibles como las protestas de la Plaza de Tiananmén de 1989. Esta censura selectiva ha llevado a una discusión más amplia sobre el equilibrio entre respetar las sensibilidades y borrar los contextos históricos.

Marc Andreessen, una figura notable en la industria tecnológica, respondió a esta tendencia creando un modelo de IA paródico, Goody-2 LLM, que evita responder preguntas consideradas problemáticas, destacando preocupaciones sobre la censura y la corrección excesiva en los sistemas de IA comerciales.

3. La necesidad de una IA diversa y de código abierto

De hecho, el problema es muy diferente de los conceptos tradicionales de protección de datos personales que utilizan «simples» Sistemas de Gestión de Bases de Datos. Las controversias en torno a Gemini de Google destacan un problema mayor dentro de la industria de la IA: la centralización del desarrollo de IA bajo unas pocas corporaciones importantes. Esta centralización corre el riesgo de crear un enfoque homogéneo para la IA que no tenga en cuenta perspectivas y sensibilidades diversas. Los expertos abogan por el desarrollo de modelos de IA de código abierto como solución para promover la diversidad en el contenido generado por IA y mitigar el sesgo.

Los modelos de código abierto pueden fomentar una gama más amplia de entradas y supervisión, asegurando que los sistemas de IA sean más reflectivos de la diversidad global y menos susceptibles a los sesgos de unos pocos desarrolladores seleccionados. Este enfoque podría democratizar el desarrollo de IA, fomentando la innovación que respeta y celebra las diferencias culturales mientras sigue siendo históricamente precisa e imparcial.

Google se compromete a esforzarse por corregir la precisión en la generación de imágenes de IA de Gemini

Las controversias en torno al modelo Gemini de Google iluminan la necesidad apremiante de diversidad y apertura en el desarrollo de IA. Al adoptar modelos de código abierto y fomentar una amplia gama de perspectivas, la industria tecnológica puede trabajar hacia la creación de sistemas de IA que no solo sean innovadores, sino también respetuosos y representativos del mundo diverso que pretenden retratar. Este enfoque es crucial para asegurar que las tecnologías de IA apoyen una comprensión más inclusiva y precisa de la historia y la cultura.

Acerca de Gemini

Gemini de Google es una herramienta inteligente que utiliza tecnología avanzada para crear imágenes a partir de descripciones que se le dan. Imagina decirle a un amigo lo que estás pensando, y él lo dibuja para ti. Gemini hace algo similar pero con una computadora. Está diseñado para entender lo que pides y luego usa su conocimiento para hacer una imagen que coincida con tu descripción. Fue anunciado oficialmente en el blog el 6 de diciembre de 2023.

Be the first to comment